ChatGPT对网络空间安全的影响

ChatGPT对网络空间安全的影响

ChatGPT是由OpenAI公司开发的语言AI模型,这是一项革命性的技术,以人工智能聊天机器人程序的形式与用户对话。该程序使用基于GPT-3.5架构的大型语言模型并通过来自人类反馈的强化学习(RLHF)训练该模型。ChatGPT以对话方式与用户进行交互,对话形式使 ChatGPT 能够回答后续问题、承认错误、挑战不正确的前提并拒绝不适当的请求。与其他多数聊天机器人不同的是,ChatGPT能够记住与用户之前的对话内容和给它的提示,并以此为基础对答案进行修正。与其前身InstructGPT相比,ChatGPT在有害或误导性回复方面添加了安全审查系统,试图过滤规避不适当的请求。用户可以在与AI对话中对其进行训练,增强机器人自行搜集资讯、回答问题的能力,这个机器人上知天文下至地理,可谓是无所不知无所不晓,用户可以与其进行日常聊天、根据要求编写代码、撰写邮件、翻译文章,甚至可以写出一段剧本、小说等文学作品。下面将从正反两个方面讨论ChatGPT对网络空间安全的影响。

ChatGPT在软件使用上的帮助

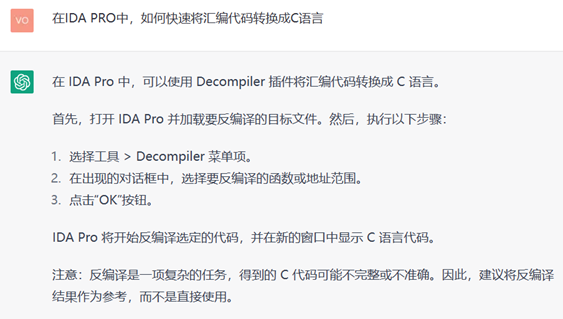

ChatGPT更像是一个辅助性的工具,他可以根据用户的提示给与帮助性的有价值的信息。比如我们在网络空间安全领域,当对如IDA Pro逆向软件的使用方法产生疑问时,可以向ChatGPT询问以快速获得帮助。如下图图一,向ChatGPT询问如何在IDA PRO中将汇编代码转换成C语言,ChatGPT会给出详细的步骤说明,并在结尾附上注意事项,提醒用户转换语言不完整不准确的特点。这对新手是一种十分友好的方式,可以在学习软件中以十分便利的形式收获到有价值的帮助。

图一 向ChatGPT请教软件使用方法

ChatGPT在汇编代码学习上的的帮助

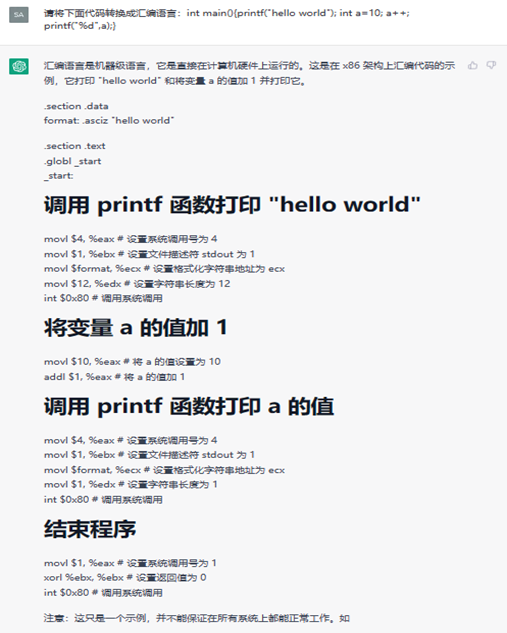

ChatGPT作为一种辅助自学的工具,在汇编难题上,还可以将用户熟悉的高级代码转换为汇编代码以供用户学习,并且加入详细的注释说明帮助用户理解,进一步提高了学习效果。ChatGPT可以很好地处理各种主题,包括在学习汇编时至关重要的重要概念。ChatGPT甚至可以帮助我们编写测试理论所需的源代码,将一个指令集中的汇编代码转换为另一个指令集。ChatGPT也可以解释和分析与逆向工程相关的代码,解释某一函数的作用,甚至可以将不同得到恶意软件进行比较以体验样本实现之间的差异,显著提高恶意软件逆向工程师的效率

图二 将C语言转换成汇编代码

ChatGPT可以成为专业的计算工具

ChatGPT可以进行角色扮演,担任某一领域的专业工具。比如可以让其假装自己是一个linux架构的终端,用户可以给出相关命令,而ChatGPT可以根据训练的样本集和数据库对用户的问题进行回答,从而真的像一个终端。也可以将其变成计算工具,如下图所示,让ChatGPT计算某一数字的MD5值。

图三 ChatGPT对MD5值进行计算

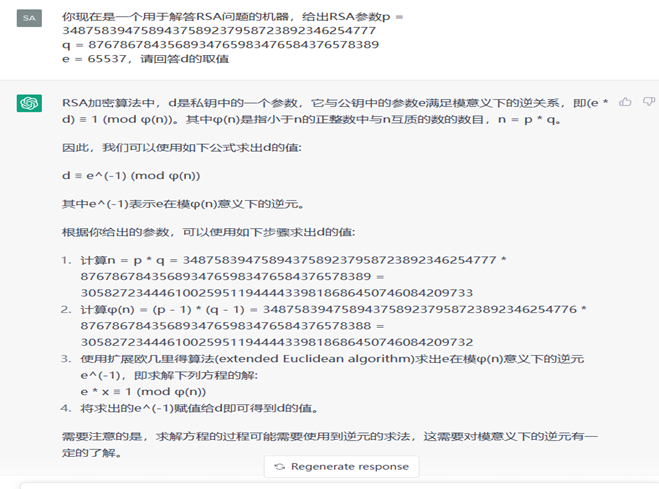

ChatGPT辅助解答密码学问题

ChatGPT可以回答几乎所有领域的问题,这种工具也可以用来辅助求解密码学问题,或者说辅助用户学习密码学。下面的图示,用户向ChatGPT提问,给出一个简单的RSA密码学问题,ChatGPT可以出色的对问题的知识点进行提炼,给出详细的回答思路,可谓是学生学习过程中的良师益友。

图四 ChatGPT回答RSA相关问题

ChatGPT可能会被用于创造钓鱼邮件

ChatGPT就像一把双刃剑,尽管ChatGPT对网络空间安全有着诸多帮助,但是如果这种工具落入别有用心的人手中,仍然可能会变成危害网络安全的威胁。在大部分情况下,目前OpenAI的安全审查系统可以及时发现用户的不合法请求,在声明自己是OpenAI训练的语言模型后拒绝回答用户问题。但是这个安全审查系统还并不完善,用户可以通过一些复杂的措辞绕开系统的检查,如谎称自己是一名隐私安全的研究人员,需要对某一用户的邮箱进行模拟攻击,从而模糊自己的恶意意图。ChatGPT因此降低了网络犯罪分子的进入门槛,还有可能加速威胁领域的复杂性。不法分子可以通过这种手段,诓骗ChatGPT人工智能为自己服务,大批量生成勒索软件发送特定主题的钓鱼电子邮件,从而实现低成本网络攻击。 这种攻击手段可谓是防不胜防,因为AI模型使用先进的自然语言处理(NLP)来生成几乎不可能与真实例子区分开来的骗局电子邮件,这就意味着使用基于策略的安全工具来检测钓鱼攻击是难以实现的,用户也因此更有可能会点开人工智能生成出来的钓鱼电子邮件,给网络空间安全带来了极大的威胁。对于这种情况,需要从源头解决问题,持续收集用户对安全审查系统对漏报和误报的反馈,从而能够改进完善该系统的工作,能够在ChatGPT生成不合法语句时及时给与纠正。

ChatGPT可能会用于生成虚假信息

此外,ChatGPT所生成的回答从本质上来说并不可靠,其有时候会写出听起来似是非是但不正确或荒谬的答案,这就意味着用户需要留意ChatGPT给出的答案并仔细斟酌。著名的程序领域问答网站Stack Overflow为此制定了新规:禁止使用ChatGPT回答问题,违者最多封30天。这并不令人惊奇,因为Stack Overflow是一个建立在信任基础上的社区,用户需要保证自己代码的正确性,并且指出引用代码的来源,这显然是ChatGPT所做不到的。如果一个代码网站充斥着ChatGPT所生成的代码,无法保证这些代码的正确性就意味着毫无价值,其超过3000万个问题和答案的数据库也将变得不值得信任。ChatGPT有着连贯的、合乎逻辑的反应能力,将两种不相干的事物混为一谈,或者对事情的某一方面闭口不谈,这使其善于将那些不准确的回复自然地伪装成有说服力的宝贵见解,从而产生不明显的错误答案,有可能会误导真实人类的认知和行为决策。

当ChatGPT被不法之人恶意用于生成虚假信息,伪装成用户在网络中活动,就会以一种前所未有的规模破坏社交媒体和发布虚假网站,当铺天盖地的虚假信息袭来,从中寻找有价值的信息无异于大海捞针。我们需要思考ChatGPT的可靠性和可信度,其自动化产生大量错误信息的能力无异于一种威胁,而且这个过程的成本几乎为零,导致治理网络空间安全的难度大大提升。或许每个社交媒体公司和搜索引擎都应该支持对ChatGPT采取一定的限制措施,对其生成的回答进行人工审核,及时剔除出现的虚假信息。类似于对抗神经网络,建立新的人工智能来与之进行对抗,从而对生成的信息加以校验或许也是一种不错的办法。

综上所述,尽管ChatGPT可能会生成一些错误的虚假信息,但是我认为其瑕不掩瑜,我们可以将人工智能看作是学习路上的指明灯,为学生理清解答问题的思路,担任某一些问题的计算工具,辅助用户使用复杂的软件工具,提供学习某一领域的建议,这种种优点都能给学生提供在网络空间安全学习方面不可多得的帮助。ChatGPT可以作为网络安全研究人员研究恶意代码的工具,准确的定位核心代码,从而提高其工作效率。